Spracherkennung. Virtuelle persönliche Assistenten mit dem Ziel natürlicher Kommunikation trainieren. Fahrbahnspuren erkennen, sodass Autos selbständig fahren können. Dies sind nur wenige Beispiele für die immer komplexeren Herausforderungen, denen sich Datenwissenschaftler mithilfe von KI stellen. Um derartige Probleme zu lösen, müssen deutlich komplexere Deep-Learning-Modelle in einem angemessenen Zeitraum trainiert werden.

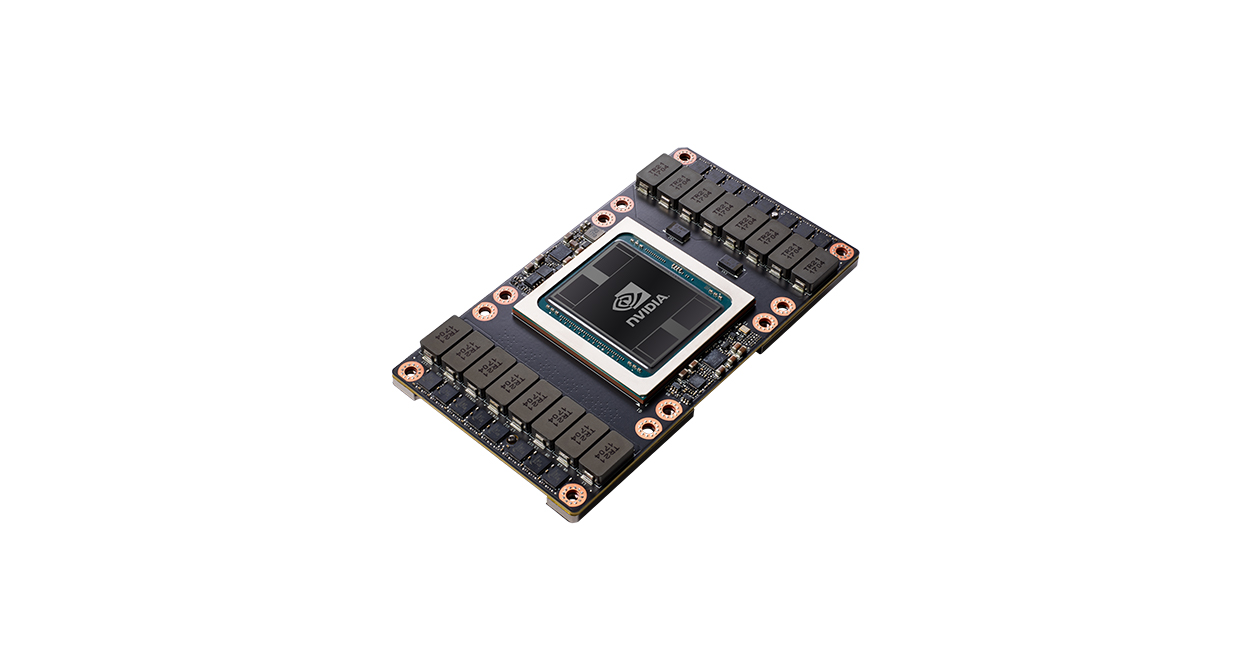

Mit 43.000 Tensor-Recheneinheiten ist der Tesla V100 der weltweit erste Grafikprozessor, der bei der Deep-Learning-Leistung die 100-TOPS-Schallmauer durchbricht. NVIDIA NVLink™ der zweiten Generation verbindet mehrere Tesla V100-Grafikprozessoren mit Übertragungsgeschwindigkeiten bis zu 160 GB/s. So entstehen die weltweit leistungsstärksten Computing-Server. KI-Modelle, die die Rechenressourcen früherer Systeme mehrere Wochen lang beanspruchen würden, lassen sich nun innerhalb weniger Tage trainieren. Dank der erheblich kürzeren Trainingszeiten bietet sich KI nun als Lösung für deutlich mehr Probleme an.