利点

対話型 AI を使用することの利点を見る

窓口の効率化

顧客との会話をリアルタイムで書き起こし、分析し、提案することで顧客の問いをすばやく解決し、コンタクト センターの窓口を支援します。

デジタル アクセシビリティ

聴覚に問題を抱える方がオーディオ コンテンツを利用したり、発話が困難な方が言いたいことを簡単に表現したりできます。

24 時間年中無休のサービス

チャットボットと AI 仮想アシスタントを利用することで、窓口の通常営業時間以外でも顧客の問いに答え、価値ある情報を提供することができます。

人を引きつける体験

ライブ キャプション、表現力豊かな合成音声、顧客の嗜好の理解などの機能で、人を引きつける体験を提供します。

ソフトウェア

NVIDIA の対話型 AI ソフトウェアを見る

ユース ケース

対話型 AI の使用方法

NVIDIA AI は産業の各種ユース ケースに対応しており、厳選されたサンプルを備えているため、対話型 AI 開発をすぐにでも始められます。

-

デジタルヒューマン

-

コンテンツ生成

-

Q&A アシスタント

-

エージェント アシスト

-

翻訳と要約

-

サービス ロボット

デジタルヒューマン

顧客サービス体験を向上させ、顧客関係を強化するために、企業は領域に特化した社内知識と「それと分かる」ブランド ボイスを持つアバターを開発しています。NIM、RAG 強化 LLM、そして Riva の世界クラスの完全にカスタマイズ可能な多言語音声/翻訳 AI を利用することで、顧客一人ひとりに合わせた応答と提案を、カスタマイズされた唯一無二の高品質ボイスで提供します。

コンテンツ生成

企業にはしばしば、テキスト、画像、動画、オーディオ、アニメーション、3D モデルなど、さまざまな社内データ ソースからインサイトを抽出し、新しいコンテンツを生成することが求められます。NVIDIA NeMo を利用することで、組織は学習済みの RAG 拡張 LLM をカスタマイズできます。領域に特化した専門知識と IP データを統合することで、関連性と精度に優れたコンテンツをニーズに合わせて作成し、カスタマイズできます。

エージェント アシスト

利用者は、コンタクト センターの担当者が利用者の直面する問題を迅速かつ効率的に解決することを期待しています。可能な限り最高の体験をエージェントが届けられるよう、RAG、LLM、音声/翻訳 AI NIM を動力とするエージェント アシスト テクノロジをさまざまな業界に属する企業がデプロイしています。このテクノロジはリアルタイムの事実と提案を提供し、効果的かつ効率的に応答できるよう、エージェントを支えています。

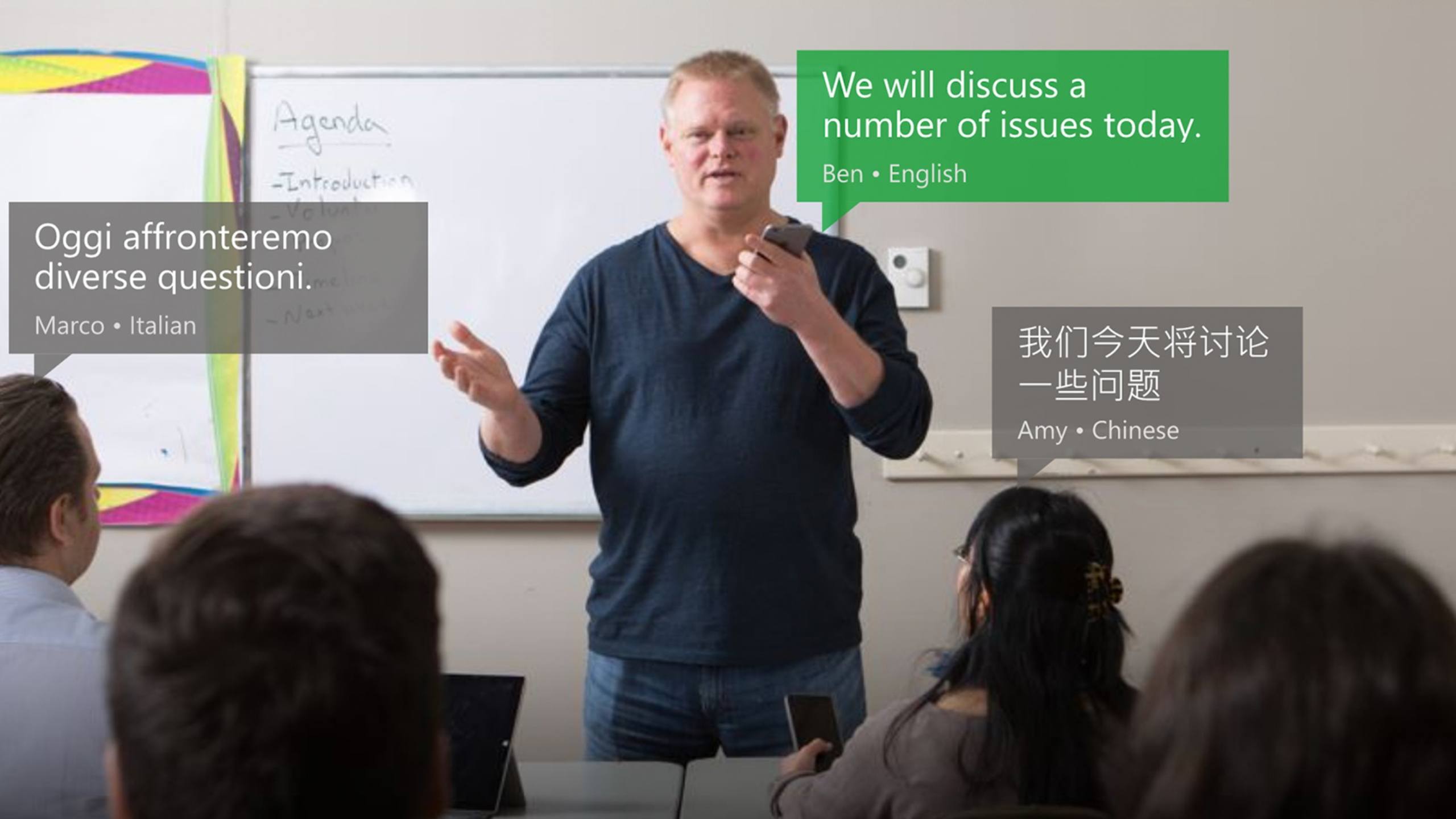

字幕、翻訳、要約

グローバル経済では、企業は毎日、無数のオンライン会議を開催し、さまざまな言語的背景を持つ顧客にサービスを提供しています。企業はリアルタイムの文字起こしと翻訳を利用し、正確な字幕をライブで生成します。また、世界中のアクセントや専門用語に対応します。要約とインサイトに LLM NIM を利用することでコミュニケーションが有効になり、世界の人とのやりとりが円滑になります。

サービス ロボット

世界中の病院、空港、小売店では、サービス ロボットを活用する機会が増えています。サービス ロボットは、レストランや製造施設では毎日繰り返される作業を行うことで現場の作業者を支援し、店舗の商品を探す顧客を支援し、患者ケアの現場では医師や看護師を支援します。

顧客事例

対話型 AI でイノベーションを推進する業界のリーダーたちの手法

導入事例

あらゆる業界で市場をリードする採用企業

-

エコシステム パートナー

-

開発者ライブラリ

GPU 対応の主要な音声、翻訳、言語のワークフローでは、エンタープライズ規模の要件を満たすことができます。

GPU で高速化する最新のディープラーニング モデルを、人気の対話型 AI ライブラリで構築します。

関連情報

最新の対話型 AI リソース

-

ブログ

-

セッション

-

トレーニング

-

動画

次のステップ

今すぐ始めませんか?

最新の関連資料、チュートリアル、技術ブログなど、対話型 AI アプリケーションの開発を始めるために必要なすべてが見つかります。

問い合わせる

セキュリティ、安定した API、NVIDIA AI Enterprise サポートを活用して、パイロット環境から本番環境へ移行する方法について、NVIDIA の製品スペシャリストがお答えします。

NVIDIA AI の最新情報を入手する

NVIDIA から最新情報、お知らせなどをお届けします。