NVIDIA NVLink를 사용하는 Tesla P100은 최상위 애플리케이션 15개 전부를 비롯해 700개 이상의 가속 HPC 애플리케이션과 모든 딥러닝 프레임워크를 통해 최대 50배까지 성능이 향상됩니다.

NVIDIA Tesla P100

세계 최초의 AI 슈퍼컴퓨팅 데이터센터 GPU

오늘날의 데이터센터는 수많은 인터커넥트된 상용 컴퓨팅 노드에 의존하므로 고성능 컴퓨팅(HPC)과 하이퍼스케일 워크로드가 제한됩니다. NVIDIA® Tesla® P100은 NVIDIA Pascal™ GPU 아키텍처를 활용하여 HPC와 AI를 모두 가속하고 처리량을 대폭으로 늘리면서 비용도 절감하는 통합 플랫폼을 제공합니다.

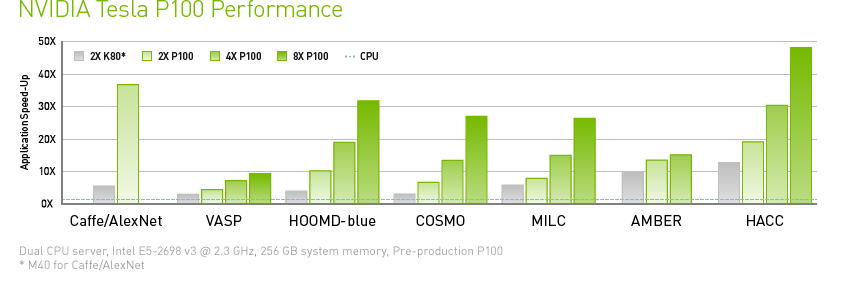

NVIDIA NVLink를 사용하는 Tesla P100은 최상위 애플리케이션 15개 전부를 비롯해 700개 이상의 가속 HPC 애플리케이션과 모든 딥러닝 프레임워크를 통해 최대 50배까지 성능이 향상됩니다.

Tesla P100은 실리콘에서 소프트웨어까지 모든 부문에서 혁신을 거치며 재탄생했습니다. 갖가지 획기적인 기술로 성능을 대폭 향상하여 세계 최고속 컴퓨팅 노드를 만드는 데 영감을 불어넣고 있습니다.

Tesla P100은 NVIDIA Pascal 아키텍처 사용 시, HPC와 하이퍼스케일 워크로드를 탁월한 성능으로 처리할 수 있습니다. 21TFLOPS의 16비트 부동 소수점(FP16) 성능을 넘어서는 Pascal은 딥러닝 애플리케이션에서 흥미롭고 새로운 가능성을 실현하는 데 최적화되어 있습니다. 또한 Pascal은 HPC 워크로드에 5TFLOPS 및 10TFLOPS 이상의 배정밀도와 단정밀도 성능도 지원합니다.

Tesla P100은 HBM2를 사용하는 CoWoS(Chip-on-Wafer-on-Substrate) 기술을 추가해 같은 패키지에 컴퓨팅과 데이터를 긴밀하게 통합했습니다. 이로써 NVIDIA Maxwell™ 아키텍처보다 3배 더 높은 메모리 성능을 제공합니다. 이는 시간 측면에서 데이터 집약적 애플리케이션용 솔루션을 다음 세대로 도약할 수 있게 합니다.

성능은 인터커넥트로 인해 저하될 때가 많습니다. 혁신적인 NVIDIA NVLink 고속 양방향 인터커넥트는 현재 동급 최고의 기술보다 5배 더 높은 성능을 제공함으로써 여러 GPU에서 애플리케이션을 확장하도록 설계되었습니다.

참고: PCIe용 Tesla P100에서는 이 기술이 지원되지 않습니다.

페이지 마이그레이션 엔진을 사용하면 개발자가 데이터 이동 관리 작업보다는 컴퓨팅 성능 조정에 더 집중할 수 있게 해줍니다. 이제 애플리케이션은 GPU의 실제 메모리 크기를 넘어 메모리 용량을 사실상 무제한으로 확장할 수 있습니다.

| PCIe 기반 서버용 P100 | NVLink 최적화 서버용 P100 | |

|---|---|---|

| 배정밀도 성능 | 4.7테라플롭스 | 5.3테라플롭스 |

| 단정밀도 성능 | 9.3테라플롭스 | 10.6테라플롭스 |

| 반정밀도 성능 | 18.7테라플롭스 | 21.2테라플롭스 |

| NVIDIA NVLink 인터커넥트 대역폭 | - | 160 GB/s |

| PCIe x16 인터커넥트 대역폭 | 32GB/s | 32GB/s |

| CoWoS HBM2 스택 메모리 용량 | 16GB 또는 12GB | 16GB |

| CoWoS HBM2 스택 메모리 대역폭 | 732GB/s 또는 549GB/s | 732 GB/s |

| 페이지 마이그레이션 엔진으로 향상된 프로그래밍 | ||

| 안정적인 ECC 보호 | ||

| 데이터센터 배포에 최적화된 서버 |

HPC와 딥러닝을 위한 세계에서 가장 빠른

GPU 가속기.

NVIDIA 가속 컴퓨팅 파트너를 찾으려면

NVIDIA 파트너 네트워크(NPN)를 확인하세요.