더욱 빠르고 정확한 AI 추론

AI 지원 애플리케이션 및 서비스를 이용해 획기적인 성능을 이끌어내세요.

추론을 통해 AI는 결과를 제공하고 모든 산업 전반에 걸쳐 혁신을 촉진할 수 있습니다. AI 모델은 크기, 복잡성, 다양성이 빠르게 확장되어 가능한 것의 경계를 넓히고 있습니다. AI 추론을 성공적으로 사용하려면 조직과 MLOps 엔지니어에게 엔드투엔드 AI 수명 주기를 지원하는 풀 스택 접근 방식과 팀이 목표를 달성할 수 있도록 지원하는 도구가 필요합니다.

NVIDIA AI 추론 플랫폼으로 차세대 AI 애플리케이션 배포

NVIDIA는 클라우드, 데이터 센터, 네트워크 엣지 및 네트워크 엣지에서 차세대 AI 추론을 지원하는 데 중요한 성능, 효율성 및 응답성을 제공하는 엔드투엔드 제품, 인프라 및 서비스 스택을 제공합니다. 임베디드 장치에서. 다양한 수준의 AI 전문 지식과 경험을 갖춘 MLOps 엔지니어, 데이터 사이언티스트, 애플리케이션 개발자 및 소프트웨어 인프라 엔지니어를 위해 설계되었습니다.

NVIDIA의 풀 스택 아키텍처 접근 방식은 AI 지원 애플리케이션이 최적의 성능, 더 적은 수의 서버, 더 적은 전력으로 배포되도록 보장하여 훨씬 더 낮은 비용으로 더 빠른 통찰력을 제공합니다.

엔터프라이즈급 추론 플랫폼인 NVIDIA AI Enterprise에는 동급 최고의 추론 소프트웨어, 안정적인 관리, 보안, API 안정성이 포함되어 있어 성능과 고가용성을 보장합니다.

이점 살펴보기

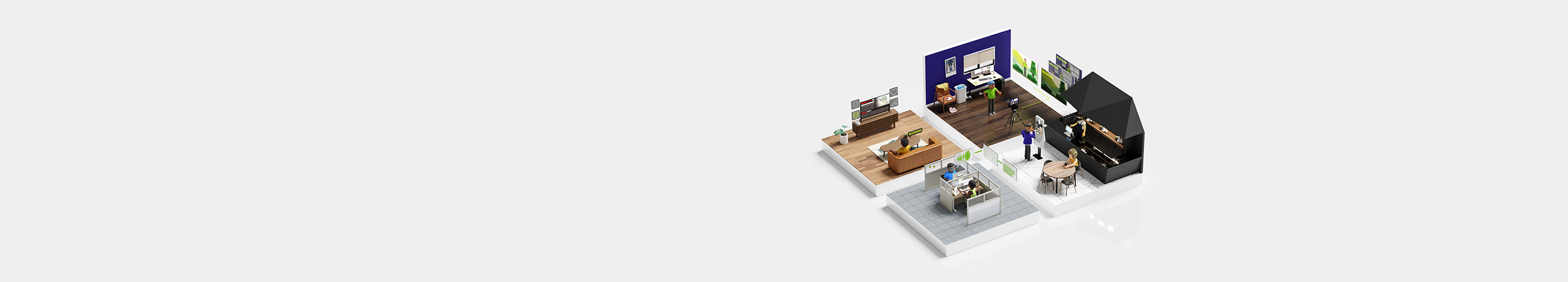

엔드투엔드 NVIDIA AI 추론 플랫폼

NVIDIA AI 추론 소프트웨어

NVIDIA AI Enterprise는 NVIDIA NIM, NVIDIA Triton™ Inference Server, NVIDIA® TensorRT™ 및 AI 애플리케이션 구축, 공유, 배포를 간소화하는 기타 도구로 구성됩니다. 기업들은 엔터프라이즈급 지원, 안정성, 관리 용이성, 보안을 통해 계획되지 않은 가동 중지 시간을 제거하면서 가치 창출 시간을 단축할 수 있습니다.

NVIDIA AI 추론 인프라

산업 전반의 AI 추론 살펴보기

추가 리소스

NVIDIA의 최신 AI 추론 소식을 받아보세요.