De reconhecimento de fala a treinamento de assistentes pessoais virtuais e ensino de veículos autônomos a dirigir, os cientistas de dados estão assumindo desafios cada vez mais complexos com a AI. A solução desses tipos de problemas requer o treinamento de modelos de Deep Learning que estão aumentando exponencialmente em complexidade, em um curto período de tempo.

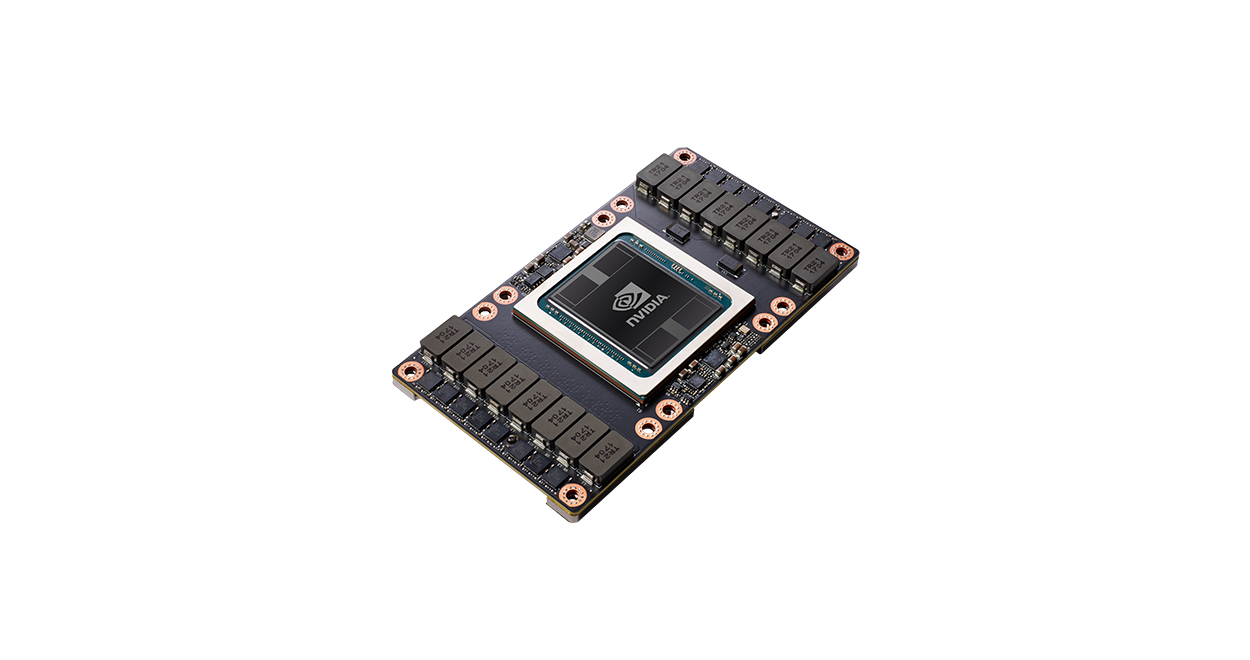

Com 640 Tensor Cores, a V100 é a primeira GPU do mundo a romper a barreira dos 100 teraFLOPS (TFLOPS) de desempenho em deep learning. A próxima geração do NVIDIA NVLink conecta várias GPUs V100 em até 300 GB/s para criar os servidores de processamento mais potentes do mundo. Os modelos de AI que usavam semanas de recursos de processamento em sistemas anteriores agora podem ser treinados em poucos dias. Com essa redução significativa no tempo de treinamento, um mundo totalmente novo de problemas agora será solucionado com a AI.