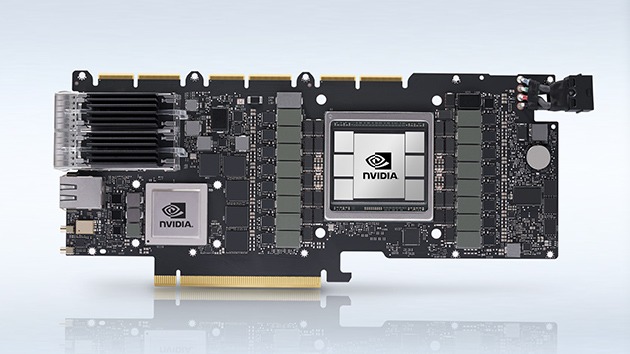

NVIDIA Ampere 架構以 540 億個電晶體打造,是有史以來最大的 7 奈米 (nm) 晶片,包含六項關鍵的突破性創新。

NVIDIA Ampere

架構

全球效能最強彈性資料中心的核心。